最近很多朋友都在玩 Google 的 Gemini 模型,尤其是 Gemini 2.5 Flash 和 Gemini 3.0Pro,速度快、上下文窗口大、免费额度也很慷慨(官方每天 50-60 次请求左右)。但在国内直接调用官方 API 总是遇到网络问题,需要稳定的代理或 VPN,体验很麻烦。

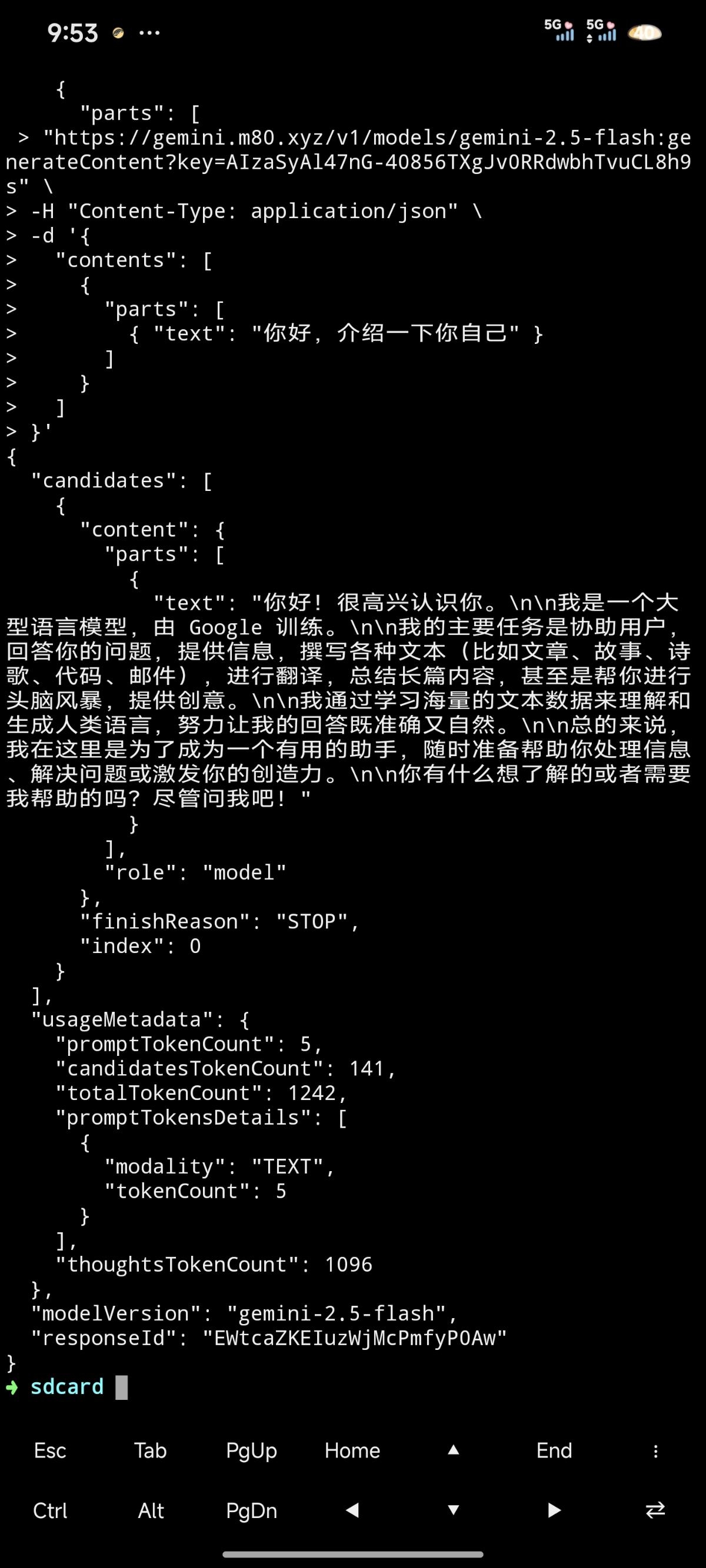

为了让大家更方便地使用 Gemini,我自己搭建了一个公开的反向代理服务:https://gemini.m80.xyz

这个地址本质上是把官方的 generativelanguage.googleapis.com 代理了一层,你只需要把请求发到我的域名,其他完全和官方 API 一致,就能绕过网络限制,直接在国内流畅调用。

为什么需要这个代理?

无需翻墙:国内直连即可使用,延迟低、稳定性好(目前服务器在海外优化节点)。

完全兼容官方 API:请求路径、参数、返回格式 100% 一致,你现有的代码只需要改一下 base URL 就能切换。

免费开放:不收费、不限速、不需要注册,目前完全公益使用。

支持所有模型:包括 gemini-2.5-flash、gemini-2.5-pro、gemini-3.0-flash 等。

支持流式响应(streaming):完美支持 SSE,适合聊天机器人等实时场景。

如何使用?

使用方法超级简单,只需要把官方的 base URL 替换成我的代理域名。

新的 base URL:https://gemini.m80.xyz/v1beta/models -H 'Content-Type: application/js

curl https://gemini.m80.xyz/v1beta/models/gemini-2.5-flash:generateContent \

-H 'Content-Type: application/json' \

-d '{

"contents": [{

"parts": [{

"text": "给我讲一个关于 AI 的冷笑话"

}]

}]

}' \

-H "x-goog-api-key: YOUR_API_KEY"

注意:

你仍然需要自己的 Google API Key(在 Google AI Studio 免费申请:https://aistudio.google.com/app/apikey)。

路径中的 /v1beta/ 保持不变,其他模型调用方式也完全一样(streamGenerateContent、countTokens、embedContent 等都支持)。

Python 示例(使用 google-generativeai 库):

import google.generativeai as genai

genai.configure(

api_key="YOUR_API_KEY",

transport="rest",

base_url="https://gemini.m80.xyz/v1beta"

)

model = genai.GenerativeModel('gemini-1.5-flash')

response = model.generate_content("写一首关于猫的短诗")

print(response.text)只需要加一行 base_url 参数,现有项目几乎零成本迁移。

当前状态与注意事项

服务目前运行稳定,日常几千次请求没问题。如果出现问题,可以在评论区或我的 GitHub 留言。

请遵守 Google 的 API 使用条款,合理使用免费额度,不要用于商业高并发滥刷。

如果流量太大,我可能会加简单的频率限制或关闭公开访问,提前知会大家。

Gemini API 反向代理,国内直连无压力

本文采用 CC BY-NC-SA 4.0 许可协议,转载请注明出处。

评论交流

欢迎留下你的想法